An Evaluation Framework for Digital ID

Un marco de evaluación para los sistemas de identificación digital

National Digital ID programmes are being deployed worldwide to facilitate inclusionOGP participating governments are working to create governments that truly serve all people. Commitments in this area may address persons with disabilities, women and girls, lesbian, gay, bisexual, tr... More of marginalised communities, and ensure more effective and open governance through efficient delivery of government services and welfare measures, reduced corruption, and preservation of national security. In many national identity programmes, the mandatory collection and storage of biometrics is pushed as the primary solution to establish and authenticate identity (particularly in developing countries with weak civil registration systems). These raise concerns around privacy and surveillance, and a potentially adverse impact on civil liberties. Centralised databases of sensitive information are also targets for cybersecurity attacks. Amidst the global push for national digital ID programmes, it is critical to adopt a rights-based approach and incorporate safeguards during their development and implementation.

One such example is the National Integrated Identity Management System (“Huduma Namba”), set up in Kenya as a foundational identity system to create a biometric population register for citizens and residents and act as a “single source of truth”. The questions raised by our evaluation framework are reflected in the litigation challenging it. For instance, while deciding the constitutionality of the Huduma Namba system, the Court stalled its implementation until an “appropriate and comprehensive regulatory framework” could be enacted. Echoing one of our first tests in the framework, the Court acknowledged that “a law that affects a fundamental right or freedom should be clear and unambiguous.” Our framework is intended as a series of questions against which such digital ID programmes may be tested. We intend for it to inform the trade-offs that must be made to ensure that rights are adequately protected and harms minimised at every stage. It comprises three kinds of tests – rule of law, rights based, and risk based.

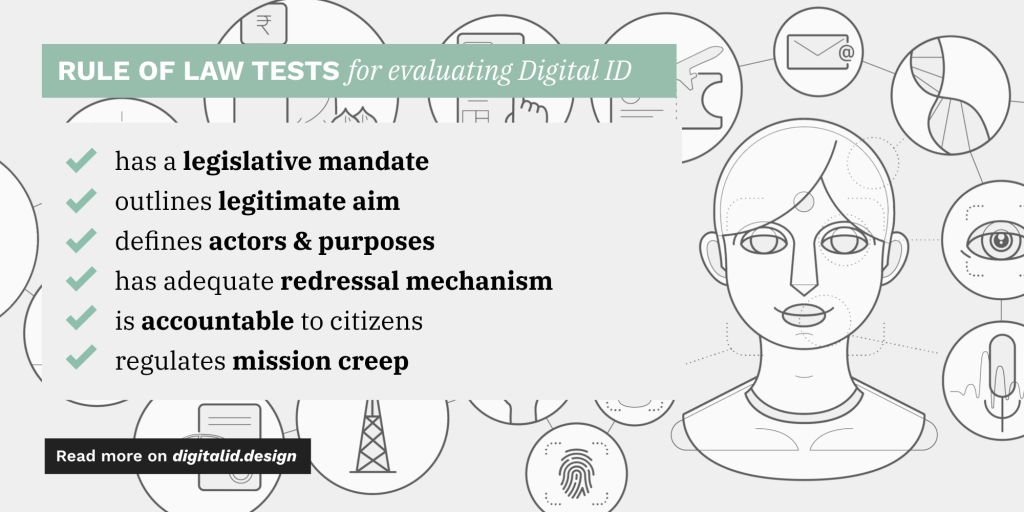

Rule of Law Tests

The use of Digital ID by state and private actors requires a rule of law framework to prevent misuse of the system for purposes outside its intended scope. Digital ID systems must aim to meet basic rule of law parameters, such as that of legislative mandate. Digital ID, by its very nature, can potentially violate an individual’s right to privacy and free speech. Any potential infringement of these rights must be sanctioned by a statutory law passed by the appropriate legislative body and not merely an executive instruction. This law must be accessible to all persons who may be impacted, and sufficiently precise as to limit discretion and prevent executive abuse. It must have a legitimate aim, to which all the purposes for which the digital ID is used must correspond. All actors and purposes that arise from this legitimate aim must be clearly identified, as well as how it applies to State and private actors. Potential mission creep should be mitigated by clearly expressed purpose limitations backed by law, to ensure that the executive authority cannot use the digital ID for unspecified purposes without a proper legislative or judicial examination of additional uses, or fresh consent from users. The law must also provide ex-ante and ex-post accountability measures.

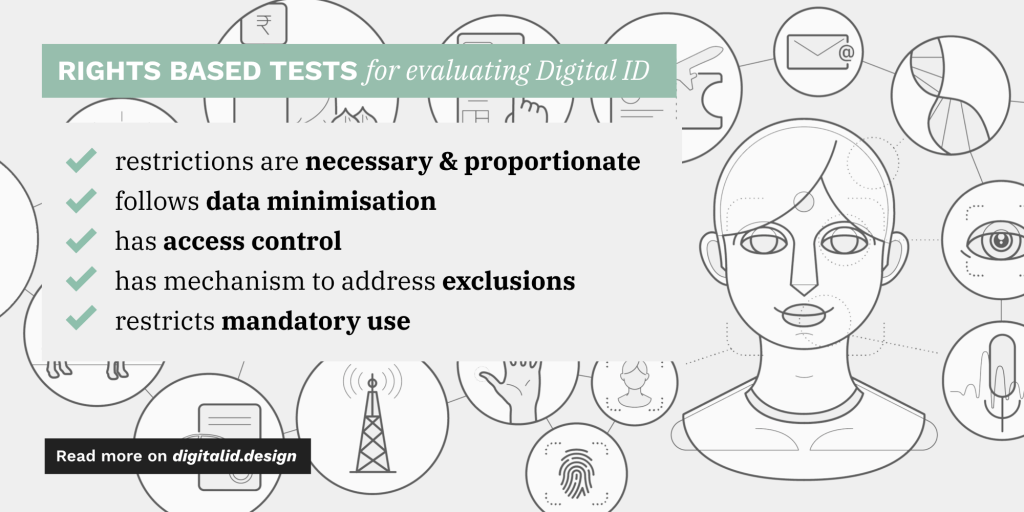

Rights Based Tests

Digital ID inherently involves restrictions on certain fundamental rights. At every stage of the project, each aspect of the identity framework must be examined against the rights it may violate, and if these violations are necessary and proportionate to its potential benefits. This is important because failure or absence of identification can lead to exclusions from basic entitlements. Principles of data minimisation must clearly dictate the amount and nature of data to be collected and stored. Access control mechanisms that regulate access to data by different actors must be laid out in the surrounding legal framework and enforced through strict civil and criminal penalties for any violations. Exclusions arise out of not only poor implementation, but also design flaws in the system. If the intended use of ID can lead to denial of services, mechanisms must be employed to ensure that individuals are not deprived. Most importantly, digital ID must not be mandatory to access benefits, and multiple alternative identification mechanisms should be provided. An opt out option that does not restrict access to the service, and mandatorily erases collected information must also be provided.

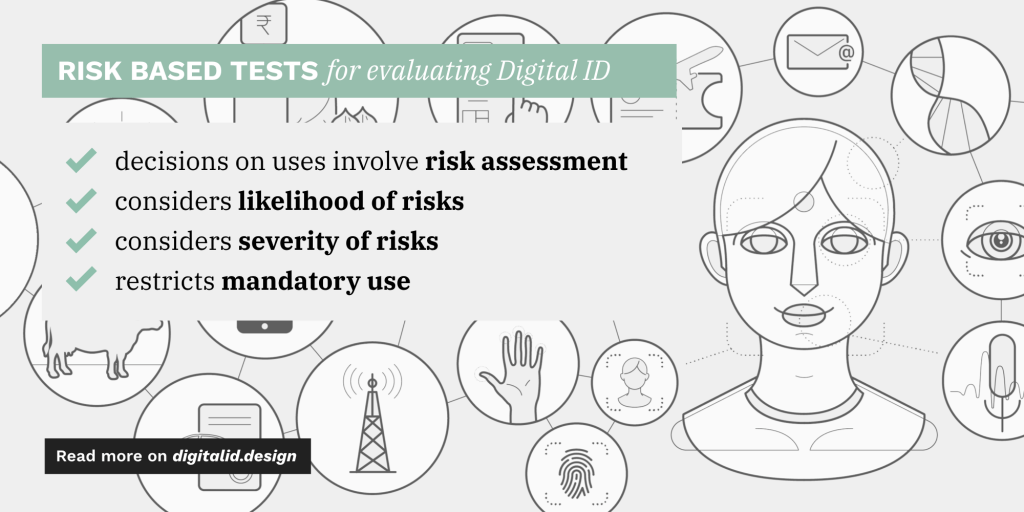

Risk Based Tests

A digital ID system must account for any potential harms. This approach to privacy requires that the system be examined against tangible risks to individuals, allowing the administrator to prioritise risks in order of severity and respond accordingly. These risks can be classified into privacy harms, exclusion harms and discriminatory harms. A differentiated approach to governance would involve categorising various uses of digital ID as per se harmful (which can be prohibited outright), per se not harmful (which can avoid regulationGovernment reformers are developing regulations that enshrine values of transparency, participation, and accountability in government practices. Technical specifications: Act of creating or reforming ...), and sensitive (where regulation is based on various factors). The risk level arising out of a digital ID is measured in terms of severity and likelihood. These harms must then be proportionately addressed by law. Threats to the ID system can be analysed based on its uses, with a wider number of uses resulting in a higher level of risk. If the risks arising from the system are demonstrably high, mechanisms to restrict use must be employed until mitigating factors are introduced. Mitigating strategies would include notifications in case of breach, having a tested business continuity plan and increased capacity buildingEnhancing the skills, abilities, and processes of public servants, civil society, and citizens is essential to achieving long-lasting results in opening government. Technical specifications: Set of ac.... The choice of strategies depends on the design of the ID system and its reliance on private entities for different functions.

Recommendations

As policy areas like digital governanceAs evolving technologies present new opportunities for governments and citizens to advance openness and accountability, OGP participating governments are working to create policies that deal with the ... More continue to grow within the Open Government PartnershipThe Open Government Partnership (OGP) is a multi-stakeholder initiative focused on improving government transparency, ensuring opportunities for citizen participation in public matters, and strengthen... More, OGP members have a unique opportunity to adopt a rights-based approach and incorporate safeguards during the development and implementation of their digital ID programmes. Our framework highlights some clear steps that governments must take.

- The consultation process at the planning stage of the programme must be inclusive, participatory and transparent in its proceedings.

- The scope of the proposed system must be clearly defined, stem from a legitimate aim and operate within a clearly defined legal framework.

- Every aspect of the system must be measured against its potential impact on fundamental rights, and whether this is necessary or proportionate to its apparent benefits.

- A differentiated approach to risk with mitigation strategies for potential harms according to their severity must be employed from the outset.

- A robust and independent grievance redressal mechanism is crucial to ensure accountability.

- No ID should be made mandatory, as this may further perpetuate the exclusion of already marginalised communities.

- Mechanisms should be implemented to ensure that no one is deprived of entitlements due to lack of identification.

- Since digital ID programmes create an inherent power imbalance between the State and its residents, it is important to ensure that the benefits they promise do not lead to hasty implementation without a rigorous evaluation.

This blogpost is based on “Governing ID: A Framework for Evaluation of Digital Identity“ by Vrinda Bhandari, Shruti Trikanad and Amber Sinha.

En todo el mundo, se están implementando programas nacionales de identificación digital para facilitar la inclusión de las comunidades marginadas y asegurar una gobernanza más efectiva y abierta a través de la provisión de servicios de gobierno y medidas sociales, la reducción de la corrupción y la protección de la seguridad nacional. En muchos programas nacionales de identidad, la colecta obligatoria de datos biométricos ha sido la solución principal para establecer y certificar la identidad de las personas (especialmente en países en vías de desarrollo en donde los sistemas de registro civil son deficientes). Lo anterior ha generado preocupaciones relacionadas con la privacidad, vigilancia y posibles afectaciones a las libertades cívicas. Además, las bases de datos centralizadas que contienen información delicada son posibles blancos de ataques cibernéticos. En este contexto de impulso a los programas nacionales de identificación digital, es fundamental incorporar una perspectiva de derechos y asegurar la aplicación de una serie de salvaguardas durante su desarrollo e implementación.

Un ejemplo de ello es el Sistema Nacional Integral de Manejo de la Identidad (“Huduma Namba”), establecido en Kenia como el sistema fundamental de identificación para crear un registro biométrico de los ciudadanos y residentes y ser una “única fuente de verdad”. Las preguntas que surgieron alrededor de nuestro marco de evaluación están reflejadas en la litigación que lo cuestiona. Por ejemplo, en el proceso de decisión sobre la constitucionalidad del sistema Huduma Namba, el tribunal detuvo su implementación hasta que se aprobara un “marco regulatorio adecuado e integral”. De forma alineada con nuestras primeras pruebas del marco, el tribunal reconoció que “una ley que afecta un derecho o libertad fundamental debe ser clara y precisa.” Nuestro marco está planteado como una serie de preguntas que deberán ser utilizadas para poner a prueba los programas de identificación digital. La intención es que ayude a tomar decisiones sobre las medidas que deben tomarse para asegurar la protección de los derechos y la minimización de los daños en todas sus fases. Abarca tres tipos de pruebas: estado de derecho, basadas en derechos y basadas en riesgos.

Pruebas de estado de derecho

El uso de sistemas de identificación digital por parte del estado y de actores privados requiere de marcos de estado de derecho que eviten malos usos del sistema para fines no establecidos en su alcance definido. Los sistemas digitales deben cumplir con una serie de parámetros de estado de derechos, por ejemplo lo relacionado al mandato legislativo. La identificación digital, por naturaleza, puede violar el derecho de las personas a su privacidad y a la libre expresión. Las violaciones a estos derechos deben ser sancionadas por leyes aprobadas por los organismos legislativos y no por instrucción ejecutiva. Dichas leyes deberán ser accesibles a todas las personas que podrían ser impactadas y deben ser lo suficientemente precisas para limitar decisiones discrecionales y evitar abusos ejecutivos. Todos los actores y objetivos que surjan de este objetivo legítimo deben identificarse claramente, así como sus aplicaciones a actores estatales y del sector privado. Deberán limitarse los cambios en la misión a través de limitaciones expresas con respaldo legal para asegurar que las autoridades ejecutivas no puedan utilizar el registro digital para objetivos no especificados si no cuenta con la supervisión legislativa o judicial para usos adicionales o el consentimiento de los usuarios. Además, la ley debe incluir medidas de rendición de cuentas ex ante y ex post.

Pruebas basadas en derechos

Las identificaciones digitales inherentemente involucran restricciones a ciertos derechos fundamentales. En todas las fases del proyecto, todos los aspectos del marco de identidad deben analizarse en función de los derechos que podría violar y tomando en cuenta si dichas violaciones son necesarias y proporcionales a sus beneficios. Lo anterior es importante debido a que la falta de identificación puede llevar a ser excluido de derechos básicos. Los principios de minimización de datos deberán dictar claramente la cantidad y la naturaleza de datos que deberá colectarse y almacenarse. Los mecanismos de control al acceso que regulan el acceso a datos por parte de diferentes actores deben establecerse en el marco legal y aplicarse a través de sanciones en caso de violación. Las exclusiones podrían no solo ser resultado de una mala implementación, sino también de fallas en el diseño del sistema. Si el uso previsto de las identificaciones puede llevar a la negación de servicios, deben implementarse mecanismos para asegurar que las personas no sean privadas de derechos. Lo que es más importante, las identificaciones digitales no deben ser un requisito para tener acceso a beneficios y deberán ofrecerse diversos mecanismos de identificación. Si la persona elige no participar en el sistema, no deberá restringirse su acceso a servicios.

Pruebas basadas en riesgos

Los sistemas de identificación digital deben tomar en consideración todos los posibles riesgos que implican. Este enfoque a la privacidad exige que el sistema sea analizado en función de los riesgos que presenta para las personas, de manera que quienes administran los programas puedan priorizar los riesgos en orden de severidad y responder adecuadamente. Estos riesgos pueden clasificarse en daños a la privacidad, daños de exclusión y daños de discriminación. Un enfoque diferenciado a la gobernanza involucraría categorizar diferentes usos de las identificaciones digitales como dañinas per se (los cuales deberán ser prohibidos directamente, no dañinos per se (los cuales podrían evitar ser regulados) y sensibles (en donde las regulaciones dependen de diversos factores). El nivel de riesgo que surge de una medida de identificación digital se mide por su severidad y probabilidad de incidencia. Estos daños deberán atenderse a través de la ley. Las amenazas a los sistemas de identificación pueden analizarse según sus usos, pues una mayor cantidad de usos resultará en un mayor grado de riesgo. Si los riesgos que surgen del sistema son altos, deberán aplicarse mecanismos para restringir su uso hasta que se implementen mecanismos de mitigación. Las estrategias de mitigación deben incluir notificaciones en caso de vulneración al sistema, un plan de continuidad y un mayor desarrollo de capacidades. La elección de la estrategia dependerá del sistema de identificación y de su dependencia en entidades privadas para diferentes funciones.

Recomendaciones

Las áreas de política como la gobernanza digital seguirán cobrando importancia en Open Government Partnership; en ese sentido, los miembros de OGP tienen la oportunidad de adoptar un enfoque basado en derechos y de incorporar salvaguardas durante el desarrollo e implementación de sus programas de identificación digital. Nuestro marco identifica algunas medidas claras que los gobiernos deben tomar.

- El proceso de consulta implementado en la fase de planeación del programa debe ser incluyente, participativo y transparente.

- El alcance del sistema propuesto deberá identificarse claramente, partir de un objetivo legítimo y operar dentro de un marco legal claramente definido.

- Todos los aspectos del sistema deberán evaluarse en función de su impacto potencial a los derechos fundamentales y según la medida en la que es necesarios y proporcionales a sus beneficios.

- Deberá utilizarse, desde el inicio, un enfoque diferenciado a los riesgos con estrategias de mitigación a posibles daños según su severidad.

- Para asegurar la rendición de cuentas, es fundamental aplicar un mecanismo independiente de denuncias.

- Los sistemas de identificación no deberán ser obligatorios, pues podrían exacerbar la exclusión de comunidades marginadas.

- Deberán implementarse mecanismos para asegurar que ninguna persona sea privada de sus derechos por no contar con identificación.

- Debido a que los programas de identificación digital pueden crear desequilibrios de poder entre los Estados y sus residentes, es importante asegurar que los beneficios que prometan no lleven a una implementación precipitada sin evaluaciones rigurosas.

No comments yet

Related Content

A Guide to Open Government and the Coronavirus: Privacy Protections

Governments are collecting unprecedented amounts of personal data to support vital public health efforts, such as tracking COVID-19 transmission and enforcing quarantine. In particular, governments and corporations are collecting and…

A Guide to Open Government and the Coronavirus: Protecting Participation and Deliberation

COVID-19 has upended policy agendas across the globe. Governments have paused nonessential legislation and regulation and fast-tracked measures to respond to the pandemic.

Challenges and Solutions

Challenges and Solutions

Opportunities in Times of Crisis: Towards an Open and Digital State

The global emergency posed by Covid-19 marks a before and after in the way we live. It might also help us rethink how we govern...

Leave a Reply